La révolution numérique à laquelle nous assistons actuellement avec l’avènement de l’intelligence artificielle dans tous les domaines de notre existence est à peu près aussi révolutionnaire que l’arrivée d’internet.

Peut-être même qu’en réalité, notamment sur le plan politique et géopolitique, l’IA marque le véritable début du XXIe siècle, car plus jamais rien ne sera comme avant dans au moins trois domaines cruciaux du fonctionnement de notre monde réel : dans les médias, la médecine et le domaine militaire.

Que cela soit dans le monde de l’information avec la multiplication des opérations d’influence et d’ingérence étrangère, y compris pour influencer le cours d’une élection, ou dans la santé avec le piratage des réseaux de certains hôpitaux comme nouvelles opérations de cyberhacking et d’escroquerie, ou enfin avec la transformation complète des conflits par des combats menés par des armadas de drones pilotés à distance, le monde réel, dépendant totalement du numérique, est en pleine révolution copernicienne.

Désormais, l’intelligence artificielle s’invite partout. Pas celle qui répond à une question lambda, mais celle qui pèse sur des choix essentiels: ce que nous lisons et croyons, la manière dont nous sommes soignés, la façon dont un pays se défend. Dans les médias, la santé et le militaire, une erreur n’est pas un simple dysfonctionnement: c’est un trouble démocratique, une prise en charge mal orientée, une faille stratégique.

Des domaines sensibles qui doivent rester sous contrôle

On parle beaucoup de régulation. Elle est utile, mais elle arrive trop tard et reste générale. Ce dont nous avons besoin maintenant, c’est de certification: des preuves concrètes, vérifiées par des tiers, que les logiciels respectent des exigences claires avant d’entrer dans une rédaction, un hôpital, une administration, une base militaire. Certifier, c’est faire pour l’IA ce que nous faisons déjà pour un avion ou un médicament: tester, documenter, surveiller, pouvoir arrêter si quelque chose déraille.

Dans les médias, des algorithmes recommandent, réécrivent, hiérarchisent. Sans garde-fous, ils renforcent la polarisation et brouillent l’autorité des faits. La réponse n’est pas de bannir l’outil, mais de l’assainir: savoir d’où viennent les données, rendre les systèmes lisibles, garder la main éditoriale et faire auditer régulièrement les outils introduits dans les rédactions.

Dans la santé, un système d’aide au diagnostic n’est pas une application comme les autres. Il participe à l’acte de soin. Il doit donc être évalué cliniquement, surveillé dans la durée, corrigé si ses performances varient et toujours placé sous supervision humaine. Aucun établissement ne distribuerait un traitement non autorisé; il ne devrait pas davantage s’en remettre à un modèle non certifié.

Dans le militaire, la tentation est d’aller vite. Mais plus la décision s’accélère, plus le contrôle doit être solide. Les systèmes doivent résister aux attaques, rester compréhensibles pour les opérateurs et intégrer un verrou de contrôle humain. La souveraineté ne se mesure pas seulement à la puissance des algorithmes, mais à notre capacité à les maîtriser.

Certifier pas réguler

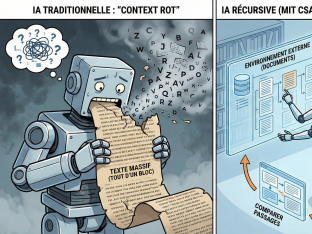

Pourquoi insister sur la certification plutôt que sur la seule régulation? Parce que la régulation fixe des principes après coup, alors que la certification oblige à prouver, en amont et dans la durée, que l’outil est sûr et qu’il le reste. C’est un contrat clair entre développeurs, acheteurs et citoyens: qui est responsable, quelles données ont été utilisées, quels tests ont été menés, comment les incidents seront gérés, quand l’autorisation pourra être retirée.

Mettre cela en place n’a rien d’une usine à gaz. On commence par un inventaire des usages, on nomme un responsable, on adopte une politique interne simple. On évalue les impacts par domaine, on fixe les seuils d’acceptation, on installe des garde-fous techniques et une journalisation des décisions. On forme les équipes, on passe un préaudit, puis un audit. Ensuite, on surveille, on corrige, on renouvelle la certification. C’est une hygiène de vie numérique à adopter au quotidien.

Derrière ces choix techniques, il y a une question humaine. L’IA doit nous aider à mieux décider, pas décider à notre place. Elle doit nous augmenter, pas nous diminuer ! Elle doit éclairer nos responsabilités, pas nous en décharger. L’image de Frankenstein n’est pas qu’un clin d’œil littéraire: une invention puissante, livrée sans règles, finit par échapper à son créateur. La certification n’est pas une chaîne qui emprisonne; c’est une main courante qui nous empêche de tomber.

Nos avantages en tant qu’Européens

L’Europe, les Nations-Unis et ses alliés ont une chance à saisir et des traditions à promouvoir. Ils savent produire des standards utiles au quotidien. En harmonisant les exigences, en mutualisant les audits, en imposant des clauses contractuelles qui engagent réellement les fournisseurs, ils peuvent faire de la confiance un avantage compétitif.

Les médias y gagneront en crédibilité, les soignants en sécurité, les forces en efficacité maîtrisée. Et les citoyens, au centre, sauront sur quoi reposent les décisions qui les concernent.

Pour passer du principe à l’action, une fondation aux objectifs totalement inédits est lancée en Suisse: GAIGI, le Geneva AI Governance Institute. Elle proposera un processus inédit de certification pour l’intelligence artificielle sensible, fondé sur les normes du droit international et institutionnel. Son objectif est simple: offrir un guichet clair pour les administrations, les entreprises et les opérateurs critiques, avec des référentiels ouverts, des audits indépendants et des labels interopérables.

Pour que la promesse d’un humain augmenté ne se transforme jamais en humain diminué, faisons de l’IA une technologie fiable, explicable et certifiée.

Axel Mazolo, expert en gouvernance de l’IA à l’initiative de la fondation Geneva AI Governance Institute