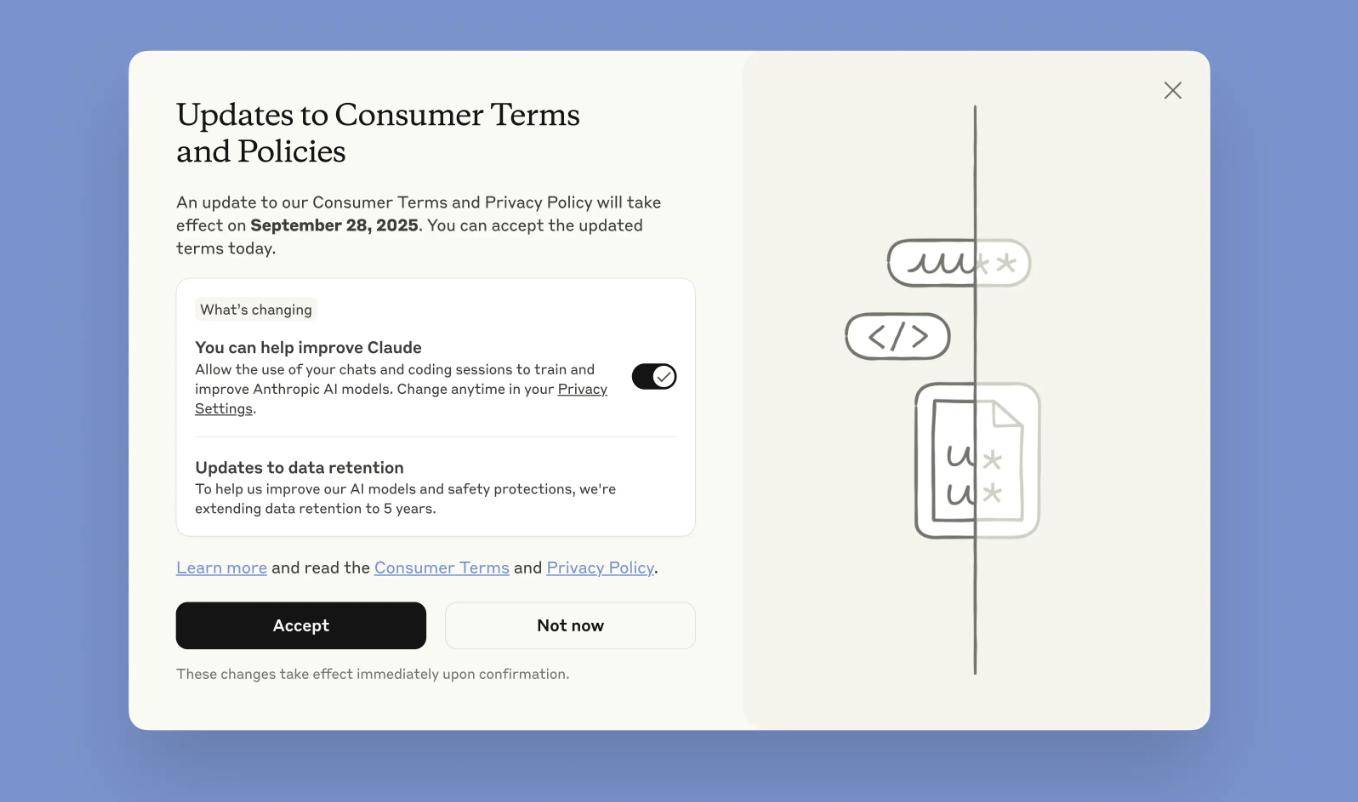

D’ici le 28 septembre, les utilisateurs de Claude, l’IA générative d’Anthropic, devront décider si leurs conversations avec le chatbot peuvent être utilisées par l’entreprise pour entrainer ses modèles d’IA ou non, a annoncé la startup américaine.

Anthropic a fait part d’un changement de politique majeur concernant la gestion des données de ses utilisateurs. Elle souhaiterait obtenir leur consentement pour les conserver et les exploiter en vue de nourrir ses modèles de langage.

Jusqu’ici, les données étaient supprimées après 30 jours, mais à compter de la fin du mois de septembre, les échanges des utilisateurs avec son agent conversationnel pourraient être conservés jusqu’à cinq ans. À condition que les utilisateurs ne s’y opposent pas.

Ce changement de politique s’appliquera aux abonnés Free, Pro, Max et Claude Code. Seuls les clients professionnels (Claude Gov, Work, Education et Api) en seront exemptés.

“Aidez-nous à vous aider”

Anthropic justifie sa demande sur son site en assurant qu’en acceptant de partager leurs données, les utilisateurs “nous aideront à améliorer la sécurité des modèles, en rendant nos systèmes de détection des contenus préjudiciables plus précis et moins susceptibles de signaler des conversations inoffensives”.

Plus encore, les abonnés “aideront les futurs modèles Claude à améliorer leurs compétences en codage, analyse et raisonnement, ce qui, à terme, permettra de créer de meilleurs modèles pour tous les utilisateurs”. Autrement dit, la startup demande de l’aide à ses utilisateurs afin de leur proposer de meilleurs services.

A lire aussi | Naviguer avec une IA : la nouvelle guerre des géants du web

Pression concurrentielle

Ce changement de position de la part d’Anthropic n’a rien d’un hasard. Il s’inscrit dans un contexte de forte pression concurrentielle. Face à des géants tels qu’OpenAI ou Google, qui profite de volumes gigantesques de données pour nourrir ses modèles respectifs de langage et d’intelligence artificielle générative, la startup américaine ne peut plus faire la fine bouche.

D’autant plus que “les données issues d’interactions réelles fournissent des informations précieuses sur les réponses les plus utiles et les plus précises pour les utilisateurs”, précise l’entreprise sur son site.

En réalité, Anthropic emprunte la même voie qu’OpenAI concernant l’exploitation des échanges de ses utilisateurs avec son IA générative. Et comme pour ChatGPT, la startup permettra à ses utilisateurs de refuser que ses données soient utilisées pour alimenter les modèles de langage. Il leur faudra pour cela le préciser lors de leur enregistrement ou se rendre dans les paramètres pour changer cela.