” Sans l’intelligence artificielle, Google et Facebook s’écroulent “

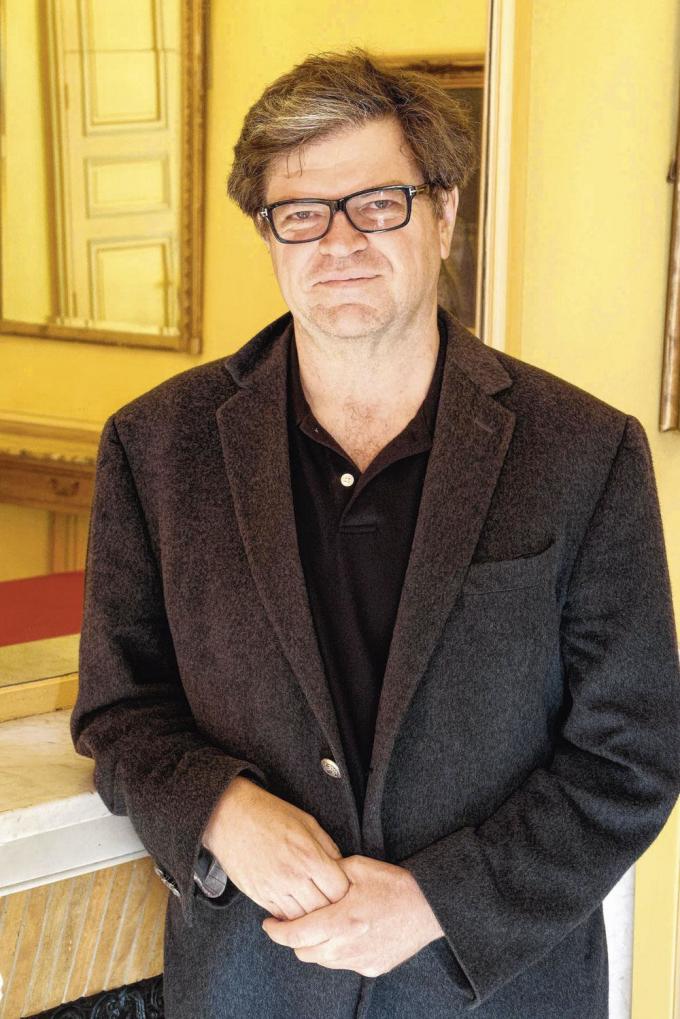

Mark Zuckerberg ne peut plus se passer de ses services. Grâce aux recherches du Français Yann Le Cun, Facebook a fait des bonds de géant dans la traduction instantanée, la reconnaissance faciale ou la détection d’images violentes. Rencontre avec un des plus grands spécialistes mondiaux de l’intelligence artificielle.

En 2013, le patron de Facebook Mark Zuckerberg pressent que les performances de l’intelligence artificielle (IA) vont exploser, et que son utilisation deviendra bientôt incontournable pour son entreprise. Pour garder un coup d’avance, il embauche Yann Le Cun, l’un des plus grands experts des techniques d’apprentissage profond, qui ont révolutionné l’IA au cours des dernières années. Au sein de Facebook, le Français crée un laboratoire de recherche fondamentale d’où sortiront des innovations majeures. Professeur à la New York University, lauréat du prestigieux prix Turing en 2019, Yann Le Cun publie aujourd’hui Quand la machine apprend. La révolution des neurones artificiels et de l’apprentissage profond (Editions Odile Jacob).

Si, d’ici la fin de ma carrière, nous parvenons à créer une machine qui égale l’intelligence d’un rat, ce sera une énorme réussite.

TRENDS-TENDANCES. Vous commencez votre livre avec une évocation de ” 2001, odyssée de l’espace “, un film plutôt angoissant sur l’avenir de l’homme et de la machine.

YANN LE CUN. Pas si sombre que ça, en fait. Le film pose une question essentielle, celle de l’alignement de valeurs. Si nous créons un jour des machines intelligentes autonomes – ce que l’on ne sait pas faire à l’heure actuelle – il faudra que leurs objectifs et leurs valeurs soient alignés avec les valeurs humaines. Ce n’est pas le cas de HAL, l’intelligence artificielle de 2001, odyssée de l’espace. Certains pensent que ce problème d’alignement de valeurs sera très difficile à résoudre. Ce n’est pas mon cas. Nous sommes habitués à établir des normes pour corriger le comportement des humains ou des entreprises. Nous faisons cela depuis des millénaires. Demain, nous le ferons aussi pour les machines.

A quoi sert l’intelligence artificielle ?

A la recherche et au filtrage de contenus sur Internet, à la traduction, à la classification de texte, à la reconnaissance d’images… L’intelligence artificielle (IA) équipe des systèmes d’assistance à la conduite, qui freinent la voiture si un piéton surgit : cela réduit le nombre de collisions de 40 %, c’est énorme ! L’IA sauve des vies. Des applications très prometteuses se développent en médecine, notamment en radiographie : détection de cancers du sein dans les mammographies, de tumeurs dans les IRM, etc. En dermatologie et en rhumatologie, cela fonctionne très bien aussi. L’industrie du médicament planche également sur le sujet. En science des matériaux, on peut aussi espérer des développements. Comme l’électricité, le moteur à vapeur ou l’ordinateur, l’intelligence artificielle va pénétrer tous les recoins de l’économie et changer la manière de travailler, dans toutes les industries. Les économistes qualifient l’IA de ” technologie à usage général “. Comme pour l’informatique, cela va prendre une dizaine ou une quinzaine d’années, le temps que les gens apprennent à s’en servir.

Vos travaux de recherche portent sur les réseaux neuronaux. En quoi cette technologie a-t-elle révolutionné l’IA ?

Les architectures particulières des réseaux de neurones, qui servent à des applications telles que la reconnaissance d’image, la traduction de langues ou la reconnaissance de la parole, se basent sur ce que l’on appelle les réseaux convolutifs, qui sont un peu mon invention. Ces systèmes, qui datent de la fin des années 1980, ont eu du mal à s’imposer jusqu’au début des années 2010, parce qu’ils étaient très gourmands en données d’entraînement et en capacité de calcul. L’explosion de la production de bases de données énormes dans notre environnement numérique, combinée à la multiplication d’ordinateurs dotés d’une puissance de calcul importante à un prix raisonnable, ont permis à la technologie des réseaux de neurones d’enfin émerger.

Le but ultime des réseaux neuronaux est-il de copier le cerveau humain ?

Non. Le but est de s’en inspirer et de reproduire son fonctionnement, sans en copier tous les détails. Les avions et les oiseaux utilisent le même principe pour voler (des ailes qui produisent de la portance), mais leur mode de fonctionnement et leur technique sont très différents. Dans le cas des réseaux de neurones, c’est la même chose. On cherche à dégager des règles informatiques ou mathématiques qui reproduisent le fonctionnement du cerveau de manière abstraite, mais qui sont appliquées différemment.

Dans votre livre, vous expliquez que l’intelligence artificielle est encore loin d’égaler le cerveau humain.

Si, d’ici la fin de ma carrière, nous parvenons à créer une machine qui égale l’intelligence d’un rat, ce sera une énorme réussite. Aujourd’hui, nous sommes déjà capables de créer des machines plus compétentes que les humains dans des domaines très pointus, par exemple pour reconnaître des espèces d’insectes à partir d’une photo, pour traduire de façon acceptable une centaine de langues, pour jouer de manière très performante au jeu de go, ou pour reconnaître le visage de milliers de personnes. Pour ces tâches spécifiques, les machines sont supérieures aux êtres humains. Mais elles ne possèdent pas l’adaptabilité de l’intelligence humaine ou de certains animaux. Elles n’ont pas non plus ce que l’on appelle le sens commun.

Qu’entendez-vous par sens commun ?

Dans les premiers mois de la vie, les humains et de nombreux animaux apprennent un nombre de choses absolument gigantesque, principalement par l’observation. A trois mois, un enfant peut distinguer les objets animés des objets inanimés. A neuf mois, il sait qu’un objet qui n’est pas porté va tomber : il a appris la gravité. A deux ou trois ans, il sait qu’un objet que l’on cache de sa vue n’a pas disparu : il a appris la notion de permanence des objets. Ce genre d’apprentissage, on ne parvient pas encore à l’inculquer aux machines, même si on y travaille.

C’est précisément l’objet de vos travaux actuels : apprendre aux machines toutes ces choses qui nous paraissent évidentes.

Le défi est de faire en sorte que les machines apprennent avec l’efficacité des humains et des animaux. A mon avis, cela passe par l’apprentissage de certaines notions comme la gravité. Si on apprend à une voiture autonome ce qu’est la gravité, elle évitera de donner un coup de volant vers un ravin.

Vos recherches portent plus précisément sur les réseaux convolutifs, qui servent à la vision. Grâce à vous, les machines ont des yeux ?

Des yeux et des oreilles, pour l’instant. Cette architecture des réseaux convolutifs est inspirée des connexions de neurones dans le cortex visuel et dans le cortex auditif. Ces réseaux sont utilisés notamment pour la compréhension de la langue naturelle, pour la traduction, ou encore pour la reconnaissance d’images.

Les performances incroyables de la reconnaissance faciale, c’est grâce à vous ?

Oui. Les réseaux convolutifs sont utilisés pour l’imagerie médicale, pour les systèmes de vision des voitures autonomes, pour la reconnaissance faciale, pour la lecture optique de caractère pour le tri d’images, etc. Quand vous postez une photo sur Facebook ou Instagram, elle passe par plusieurs réseaux convolutifs. L’un des objectifs de cette technologie est de savoir à qui il faut montrer ce contenu. Si vous postez une photo de voilier et qu’un de vos amis est intéressé par la voile, il verra votre publication. Par contre, si vous postez des dizaines de photos de votre chat, et que ce même ami n’est pas intéressé par les chats, il ne verra pas ces photos. Les réseaux convolutifs peuvent aussi repérer des images violentes, de la propagande terroriste ou encore de la pédopornographie.

Cette technologie, que vous avez contribué à développer, est parfois utilisée, notamment en Chine, à des fins de surveillance de masse. Cela ne vous choque pas ?

Si, bien sûr, c’est très dérangeant. Cette technologie a des effets qui sont en grande majorité positifs. Ce qui permettra de garantir que ces effets majoritairement positifs le resteront sur le long terme, c’est la force de nos institutions démocratiques. En Chine, ces institutions démocratiques n’existent pas vraiment, et cette technologie y est effectivement utilisée massivement pour surveiller les gens. Certains Chinois pensent que c’est positif en termes de sécurité, mais cela permet au gouvernement de contrôler ses citoyens, notamment les populations rebelles ( les Ouïghours, par exemple, Ndlr). En Europe, ce serait totalement inacceptable. Les gens ne sont pas prêts à accepter des technologies qui envahissent à ce point leur vie privée.

Ce n’est pas parce que les machines peuvent nous surpasser qu’elles voudront nous dominer.

Facebook détient une des plus grandes bases de données de visages au monde. N’est-ce pas un danger pour nos libertés individuelles ?

En qui avez-vous confiance pour conserver le caractère privé de vos données ? En ce qui me concerne, sachant comment fonctionne l’industrie, j’ai confiance en des compagnies comme Facebook et Google. Ces entreprises savent ce qu’elles font au niveau de la protection des données. Contrairement à une idée répandue, Facebook ne vend pas vos données privées aux publicitaires et ne cède pas ces données aux gouvernements.

Facebook ne vend pas nos données, mais Facebook vend des profils basés sur nos données privées…

Oui, mais tout cela reste à l’intérieur de Facebook. Elles ne sont révélées à personne, aucun humain ne regarde ces données, elles ne sont pas distribuées hors de Facebook… Tout cela est extrêmement protégé, malgré tout ce que vous pouvez lire dans la presse.

Il y eu des piratages, des fuites de données, des données partagées avec des acteurs peu scrupuleux…

Ce ne sont pas des piratages. Ce sont des abus de confiance, comme dans l’affaire Cambridge Analytica ( pour rappel, cet organisme piloté par des proches de Donald Trump s’est procuré de manière trouble des données Facebook de millions d’Américains, qui ont ensuite été matraqués de publications ” orientées ” durant la dernière campagne présidentielle américaine, Ndlr). A l’origine de cette affaire, on trouve une plateforme de Facebook, qui permettait de développer des applications pour le réseau social. Facebook s’est aperçue que des abus étaient possibles sur cette plateforme. En conséquence, elle a été fermée par Facebook, deux ans avant l’éclatement du scandale. Depuis, ce genre de débordement n’est plus possible.

Comment Mark Zuckerberg vous a-t-il convaincu de travailler pour lui ?

En 2013, un de mes anciens étudiants m’a expliqué qu’il allait rejoindre Facebook et il m’a invité à visiter l’entreprise. Mark Zuckerberg m’a proposé alors de venir manger chez lui. Il m’a expliqué son projet, m’a dit qu’il voulait créer un labo de recherche fondamentale en IA. Je trouvais cela ambitieux, intéressant…

Cela vous a-t-il surpris qu’une telle proposition vienne de Facebook ?

Oui et non. Facebook avait déjà exploré plusieurs manières de se lancer dans l’aventure de l’IA. L’instinct naturel dans la Silicon Valley, c’est d’acquérir des start-up, afin de mettre la main sur des talents en ingénierie, sur des produits ou sur une clientèle. Mais cela ne permet pas de se lancer dans la recherche. Pour cela, il faut embaucher des chercheurs, avec une certaine stabilité sur le long terme. Ce que j’ai dit à Mark Zuckerberg, c’est qu’il fallait pratiquer de la recherche ” ouverte “.

Pour quelle raison ?

La recherche est de meilleure qualité si les chercheurs doivent publier leurs travaux. Ce système ouvert permet d’essaimer dans la communauté de la recherche, pour qu’elle travaille sur des problématiques utiles. La question n’est pas de savoir si l’IA de Facebook est en avance sur celle de Google. La question, c’est de trouver la technologie adéquate pour créer des produits innovants, par exemple des assistants virtuels intelligents. La communauté internationale de la recherche doit progresser. Nous y contribuons en publiant tous nos résultats, mais aussi tous nos logiciels. Mark Zuckerberg a été totalement convaincu par mon argumentaire. J’ai fixé deux conditions : je ne quitte pas mon job de professeur et je reste à New York. Il a dit ” ok “.

Vos travaux de recherche font-ils gagner de l’argent à Facebook ?

Oui. Sous trois aspects. Un : l’augmentation de l’efficacité des services existants, comme la reconnaissance de la parole, qui a fortement progressé depuis qu’on utilise le deep learning ( l’ensemble des méthodes d’apprentissage automatique de la machine, Ndlr). Cela permet par exemple de produire automatiquement des sous-titres de vidéos. Deux : la création de nouveaux services, comme la traduction automatique. Trois : la protection de l’entreprise vis-à-vis de contenus indésirables, comme la propagande terroriste ou la pédopornographie. Aujourd’hui, si on retire l’IA et plus particulièrement les techniques les plus récentes de deep learning de services comme Google et Facebook, ces compagnies s’écroulent.

Faut-il avoir peur de l’IA ?

Non. Nous devons nous assurer que l’utilisation qui en est faite par la société est positive. Il faut éviter de mettre des caméras équipées de la reconnaissance faciale à tous les coins de rue. Mais les aspects bénéfiques de l’IA sont innombrables : dans la médecine, pour la sécurité routière, l’accès à l’information, la réduction du coût de production des produits manufacturés, etc.

Vous planchez sur des machines qui sont capables de nous surpasser. Ne pourraient-elles pas un jour se retourner contre l’homme ?

Non, je n’y crois pas du tout. Ce n’est pas parce que les machines peuvent nous surpasser qu’elles voudront nous dominer. Dans La Guerre des étoiles, le robot C-3PO connaît six millions de langues, mais il n’a aucune envie d’être le chef. Il suffit de construire des machines intelligentes dépourvues de ce désir de domination, qui est une caractéristique propre à l’être humain. Cela dit, si on construit des machines autonomes, il va falloir s’assurer que les objectifs qu’on leur donne sont alignés avec les valeurs humaines. Comme je l’ai dit, il faut éviter le scénario à la 2001, odyssée de l’espace. Dans le film de Stanley Kubrick, à cause d’un décalage, la machine décide de devenir meurtrière parce qu’elle estime que c’est la seule manière de remplir sa mission. Il faudra donc installer des garde-fous. Mais là, on discute du sexe des anges : la technologie permettant de construire ce genre de machine autonome n’existe pas encore. Mais ça viendra.

Profil

? Né en 1960 à Paris.

? Diplômé de l’Ecole supérieure d’ingénieurs en électronique et électrotechnique (ESIEE) de Paris et de l’Université Pierre et Marie Curie (Paris).

? En 1988, il rejoint les laboratoires de AT&T Bell.

? Il est nommé, en 1996, directeur du département Image processing research chez At&T Labs.

? En 2003, il devient professeur de la New York University.

? Il prend le poste de directeur de Facebook AI Research en 2013.

? En 2015, il préside à l’ouverture d’un centre de recherche IA à Paris.

? En mars 2019, ses travaux sur le deep learning sont récompensés par le prix Turing (Le ” Nobel ” de l’informatique), qu’il décroche avec Geoffrey Hinton et Yoshua Bengio.

? Il publie en octobre 2019Quand la machine apprend. La révolution des neurones artificiels et de l’apprentissage profond.

Vous avez repéré une erreur ou disposez de plus d’infos? Signalez-le ici